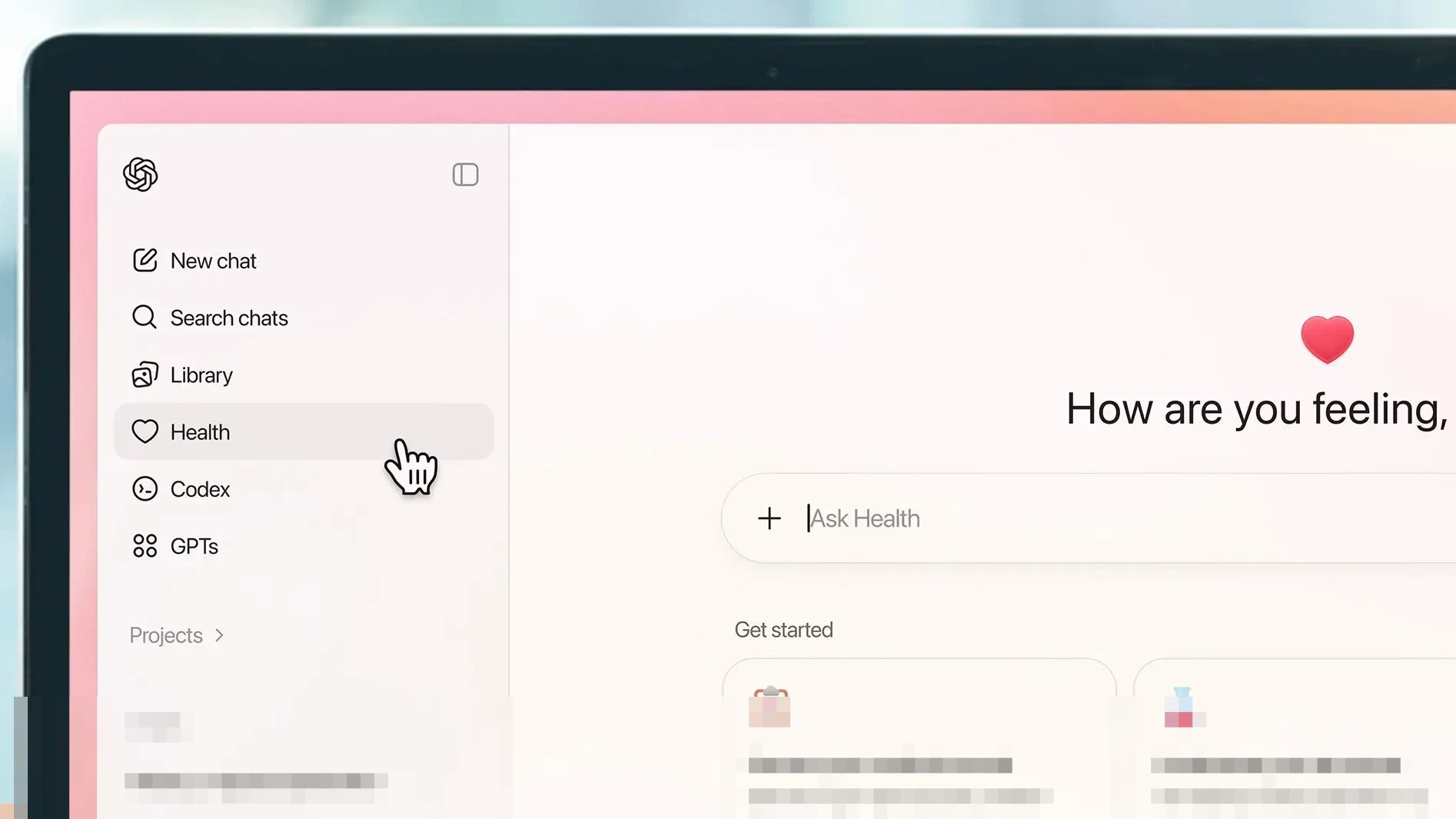

OpenAI baru saja meluncurkan fitur terbarunya, ChatGPT Health, yang menjanjikan dukungan revolusioner untuk perawatan medis melalui kecerdasan buatan. Fitur ini dirancang sebagai klinik virtual khusus yang mampu memproses rekam medis elektronik (EMR) serta data dari aplikasi kebugaran dan kesehatan. Tujuannya adalah memberikan respons personal mengenai hasil lab, diet, olahraga, hingga persiapan kunjungan dokter.

Namun, di tengah euforia adaptasi AI dalam berbagai sektor, seorang penulis lepas teknologi, Eric Hal Schwartz, menyatakan keraguannya. Ia menegaskan tidak akan mendaftar untuk layanan ChatGPT Health dalam waktu dekat, meskipun OpenAI menggembar-gemborkan nilai dan jaminan keamanan serta privasi ekstra yang ditawarkan.

Simak artikel informatif lainnya di Mureks melalui mureks.co.id.

Isu Kepercayaan dan Risiko Data Pribadi

Pusat dari keraguan Schwartz adalah masalah kepercayaan. Meskipun terkesan dengan kemampuan ChatGPT secara umum, ia tetap skeptis terhadap alat yang “mampu mengarang omong kosong secara santai” untuk urusan kesehatan yang krusial. Baginya, kenyamanan tidak sebanding dengan menyerahkan kendali atas data paling sensitif miliknya.

“Menjelajahi pertanyaan kesehatan yang terisolasi secara fundamental berbeda dengan memberikan platform akses ke rekam medis lengkap dan riwayat kesehatan seumur hidup Anda,” jelas Alexander Tsiaras, pendiri dan CEO platform data medis StoryMD. “Kepercayaan akan menjadi tantangan utama, tidak hanya bagi individu tetapi juga bagi sistem perawatan kesehatan secara keseluruhan.”

Kekhawatiran utama Schwartz terletak pada penyerahan EMR kepada perusahaan yang memiliki motif keuntungan dan rekam jejak keamanan data yang tidak sempurna. Ia secara naluriah menolak gagasan memberikan akses informasi kesehatan paling intim kepada entitas komersial.

Ketiadaan Perlindungan Hukum HIPAA

Salah satu poin krusial yang disoroti adalah status hukum OpenAI. Sebagai perusahaan teknologi, OpenAI bukanlah penyedia layanan kesehatan. Ini berarti Undang-Undang Portabilitas dan Akuntabilitas Asuransi Kesehatan (HIPAA) di Amerika Serikat, dengan kewajiban hukum dan perlindungan ketatnya untuk informasi medis, tidak berlaku untuk ChatGPT Health. Dalam ringkasan Mureks, ketiadaan payung hukum ini menempatkan pengguna dalam posisi rentan.

Tanpa HIPAA, pengguna harus bergantung pada kebijakan dan niat perusahaan semata, tanpa standar yang dapat ditegakkan secara hukum. “Kepercayaan itu bergantung pada transparansi: bagaimana data diserap, bagaimana halusinasi dicegah, bagaimana bukti klinis longitudinal digabungkan dari waktu ke waktu, dan apakah platform beroperasi dalam kerangka peraturan yang ditetapkan, termasuk HIPAA,” tambah Tsiaras.

Ancaman Kebocoran dan Permintaan Hukum

Data kesehatan yang keluar dari sistem perawatan kesehatan tradisional menghadapi serangkaian kerentanan baru. Berita utama tentang kesulitan platform teknologi besar dalam menjamin perlindungan data yang kedap udara dari kebocoran dan peretasan terlalu sering muncul. Selain itu, data kesehatan pribadi dapat menjadi subjek panggilan pengadilan, penemuan hukum, atau bentuk pengungkapan paksa lainnya. Dalam beberapa kasus, perusahaan dapat dipaksa menyerahkan catatan pribadi untuk memenuhi perintah pengadilan atau permintaan pemerintah. HIPAA memiliki pertahanan yang jauh lebih kuat terhadap tekanan hukum semacam itu dibandingkan undang-undang privasi teknologi konsumen standar di bawah operasi ChatGPT.

Meskipun ChatGPT Health menawarkan daya tarik dengan kemampuannya memberikan penjelasan jargon medis yang lebih jelas, menyoroti hal-hal yang perlu didiskusikan dengan dokter, dan menganalisis hasil tes yang membingungkan, risiko informasi yang menyesatkan atau fiktif tetap tinggi. Terlebih lagi, fitur ini sangat menggiurkan bagi mereka yang kesulitan mengakses layanan medis reguler.

Pentingnya Pengawasan Manusia

Schwartz menyimpulkan bahwa perawatan kesehatan yang terjangkau dan mudah diakses adalah tujuan yang patut dikejar. Namun, privasi, kepercayaan, dan pengawasan manusia yang berarti tidak boleh menjadi korban dalam pengejaran tersebut. Masyarakat sudah khawatir tentang bagaimana data mereka dikumpulkan dan digunakan oleh platform AI. Memusatkan informasi yang lebih sensitif dengan satu entitas komersial tidak akan mengurangi kekhawatiran tersebut.

“Ini adalah persyaratan mendasar,” kata Tsiaras. “Yang sebenarnya dibutuhkan orang adalah rekam medis yang sehat secara klinis dan longitudinal yang mendukung interaksi pasien dan penyedia layanan pasien yang bermakna, bukan lapisan kebisingan lainnya.”