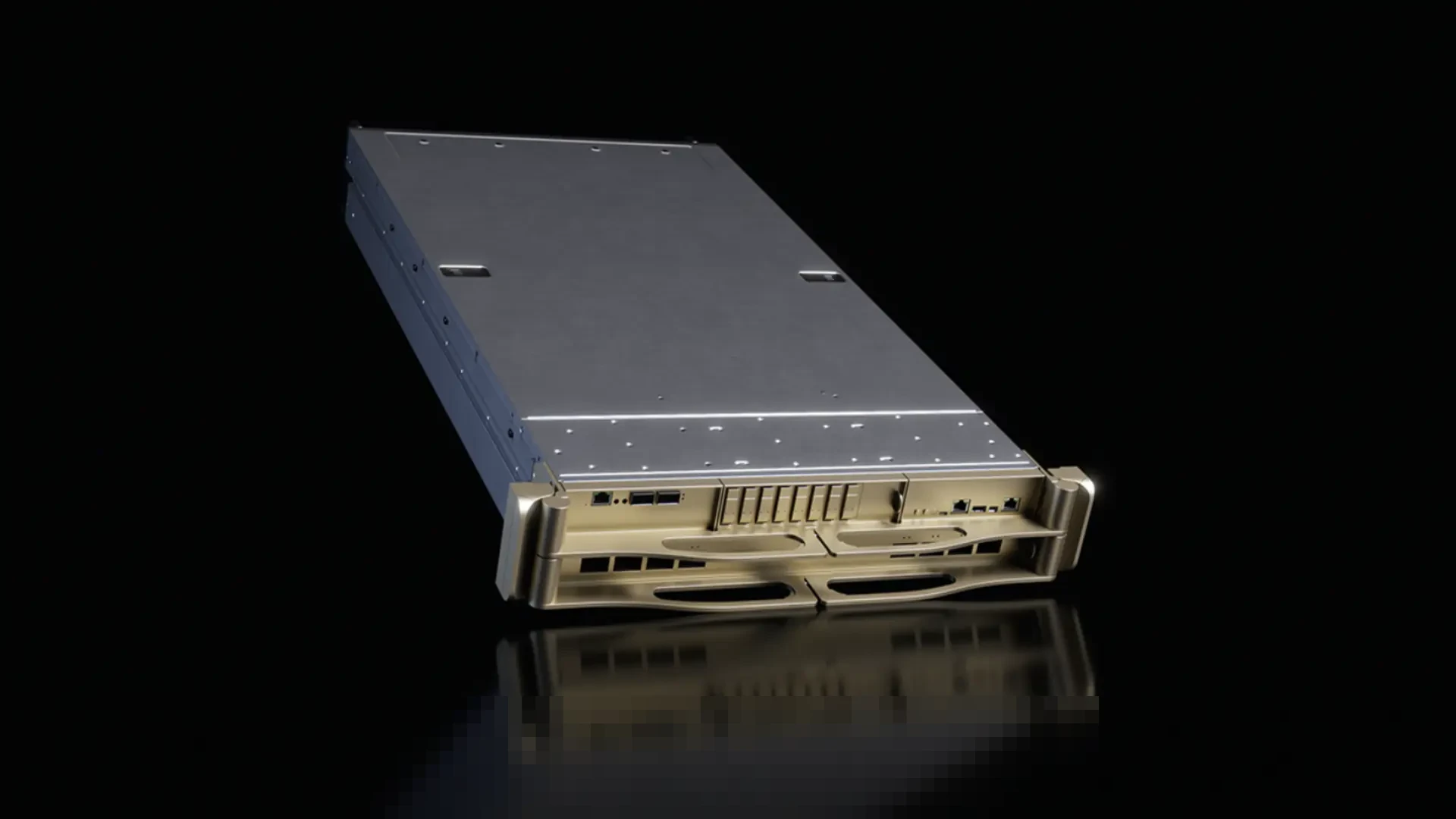

Nvidia secara resmi memperkenalkan DGX SuperPOD generasi terbarunya yang ditenagai oleh platform Rubin di ajang Consumer Electronics Show (CES) 2026, Sabtu, 10 Januari 2026. Sistem ini dirancang khusus untuk menghadirkan komputasi kecerdasan buatan (AI) ekstrem dalam rak yang terintegrasi dan padat, sekaligus menantang dominasi kompetitor seperti Huawei.

Dengan hanya 576 unit GPU Rubin, DGX SuperPOD ini diklaim mampu menghasilkan performa FP4 sebesar 28,8 Exaflops. Angka ini menunjukkan efisiensi yang signifikan dibandingkan dengan SuperPod Atlas 950 milik Huawei yang mengklaim 16 Exaflops FP4 per SuperPod. Catatan Mureks menunjukkan, Nvidia mencapai efisiensi per GPU yang lebih tinggi dan membutuhkan unit yang lebih sedikit untuk mencapai tingkat komputasi ekstrem.

Mureks juga menyajikan berbagai artikel informatif terkait. mureks.co.id

Arsitektur Rubin untuk Komputasi AI Terpadu

Setiap sistem DGX Vera Rubin NVL72 mengintegrasikan 36 CPU Vera, 72 GPU Rubin, dan 18 DPU BlueField 4. Kombinasi ini menghasilkan performa FP4 gabungan sebesar 50 petaflops per sistem. Melalui throughput NVLink agregat yang mencapai 260TB/s per rak DGX, seluruh memori dan ruang komputasi dapat beroperasi sebagai satu mesin AI yang koheren.

GPU Rubin sendiri dilengkapi dengan Transformer Engine generasi ketiga dan kompresi yang dipercepat perangkat keras. Fitur ini memungkinkan beban kerja inferensi dan pelatihan diproses secara efisien dalam skala besar. Konektivitas diperkuat oleh switch Ethernet Spectrum-6, InfiniBand Quantum-X800, dan SuperNIC ConnectX-9, yang mendukung transfer data AI berkecepatan tinggi.

Setiap rak DGX juga dilengkapi dengan memori cepat 600TB, penyimpanan NVMe, dan memori konteks AI terintegrasi. Ini mendukung pipeline pelatihan dan inferensi secara bersamaan. Desain SuperPOD Nvidia menekankan kinerja jaringan end-to-end, memastikan kemacetan minimal dalam klaster AI besar.

Integrasi Perangkat Lunak dan Efisiensi Operasional

CEO Nvidia, Jensen Huang, menegaskan visi perusahaannya terkait inovasi ini. “Seluruh tumpukan sedang diubah,” ujarnya, mengacu pada arsitektur komputasi berbasis Rubin yang baru.

Platform Rubin juga mengintegrasikan orkestrasi perangkat lunak canggih melalui Nvidia Mission Control. Sistem ini menyederhanakan operasi klaster, pemulihan otomatis, dan manajemen infrastruktur untuk “pabrik AI” berskala besar. Performa individual sistem NVL8 bahkan disebut 5,5 kali lebih tinggi dalam FLOPS FP4 dibandingkan arsitektur Blackwell sebelumnya.

Sementara Huawei cenderung meningkatkan skala melalui jumlah perangkat keras, Nvidia menekankan efisiensi tingkat rak dan kontrol perangkat lunak yang terintegrasi erat. Pendekatan ini, yang didukung oleh perangkat lunak Nvidia AI Enterprise dan layanan mikro NIM, dapat mengurangi biaya operasional untuk beban kerja AI skala industri.